Что такое Ollama: персональный сервер для «мозгов» ИИ

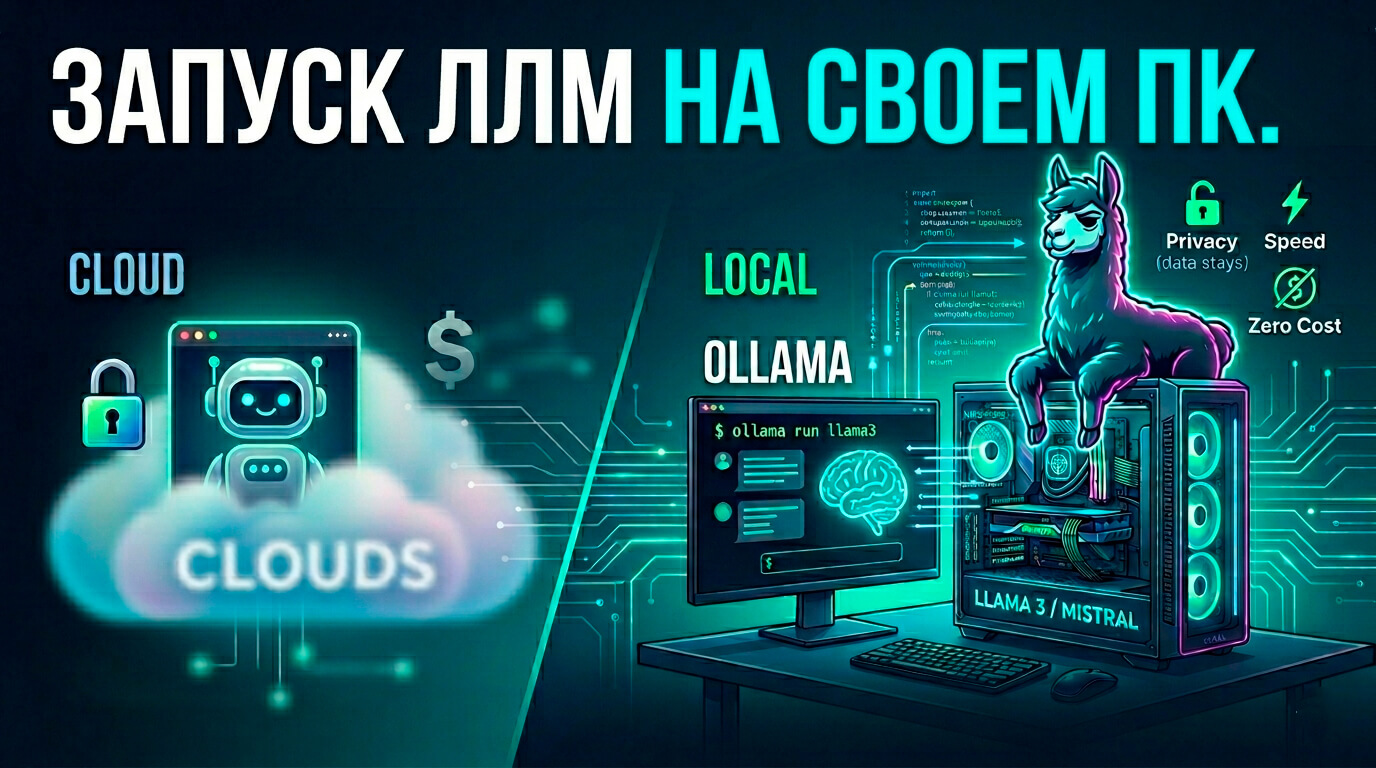

Долгое время работа с нейросетями напоминала аренду дорогого автомобиля: вы могли пользоваться мощностью GPT-4 или Claude, но только через «терминал» компании-владельца, оплачивая каждую поездку (токен) и передавая свои данные на чужие серверы. Ollama - это инструмент, который меняет правила игры, позволяя забрать этот «автомобиль» в свой гараж.

Технически Ollama представляет собой компактное приложение (фреймворк) с открытым исходным кодом, которое превращает ваш обычный компьютер в полноценный сервер для запуска больших языковых моделей (LLM).

Ключевые особенности концепции:

Локальность и приватность: Все вычисления происходят на вашем процессоре и видеокарте. Ваши документы, корпоративная переписка или личные мысли не уходят в облако. Это критически важно для юристов, медиков и программистов, работающих с закрытым кодом.

Экономия: Вам больше не нужно платить за подписки или API-запросы. Единственная трата - это электричество и разовая покупка железа.

Контейнеризация (как в Docker): Главная заслуга Ollama в том, что она упаковала сложные нейросети в простые образы. Раньше для запуска модели нужно было вручную устанавливать Python, драйверы, зависимости и скачивать десятки гигабайт весов с Hugging Face. Ollama делает это одной командой.

Универсальный API: После запуска Ollama работает в фоне как локальный веб-сервер. Любое ваше приложение (чат-бот, текстовый редактор или скрипт на Python) может общаться с ней через стандартные запросы.

По сути, это «прослойка», которая берет на себя всю тяжелую математику и управление памятью, предоставляя вам удобный интерфейс для общения с ИИ.

Практическое руководство: Как установить и запустить Ollama

Процесс установки максимально упрощен и не требует навыков системного администрирования.

Шаг 1. Загрузка

Перейдите на официальный сайт ollama.com. Программа поддерживает три основные платформы:

macOS: Скачивается как обычное приложение (.zip).

Windows: Доступен стандартный инсталлятор (.exe).

Linux: Устанавливается одной командой в терминале: curl -fsSL [https://ollama.com/install.sh](https://ollama.com/install.sh) | sh

Шаг 2. Первый запуск модели

После установки откройте терминал (или командную строку Windows) и введите команду для запуска модели. Самый популярный выбор для начала - модель Llama 3 от Meta или Mistral.

Введите в консоли: ollama run llama3

Что произойдет дальше:

Система проверит, есть ли модель на диске.

Если нет - начнется автоматическая загрузка (обычно это 4–5 ГБ).

Как только загрузка завершится, появится приглашение к диалогу: >>> Send a message.

Теперь вы можете общаться с нейросетью прямо в консоли. Чтобы выйти из чата, введите /bye.

Шаг 3. Управление библиотекой моделей

Ollama позволяет держать на компьютере десятки разных моделей под разные задачи (программирование, перевод, анализ данных).

Чтобы посмотреть список всех скачанных моделей: ollama list

Чтобы удалить ненужную модель: ollama rm [название]

Чтобы обновить модель до последней версии: ollama pull [название]

Шаг 4. Использование в сторонних интерфейсах (для комфорта)

Работать в черном окне терминала не всегда удобно. Поскольку Ollama запускает сервер на порту 11434, вы можете подключить к ней графические оболочки, которые выглядят как привычный ChatGPT.

Популярные варианты:

Open WebUI: Самый продвинутый интерфейс (требует Docker).

Enchanted (для Mac/iOS): Лаконичное приложение для работы с вашей локальной Ollama.

Page Assist: Расширение для браузера, которое позволяет использовать локальный ИИ прямо на веб-страницах.

Технические требования

Для комфортной работы желательно иметь:

Оперативная память: Минимум 8 ГБ для маленьких моделей (7B параметров), 16 ГБ и выше для более умных моделей.

Видеокарта (GPU): Наличие GPU от NVIDIA или чипов Apple M1/M2/M3 значительно ускоряет генерацию текста. Если видеокарты нет, Ollama будет использовать процессор, но скорость ответов будет заметно ниже.

Итог: стоит ли переходить на Ollama?

Появление Ollama - это не просто выход очередной программы, а важный шаг к децентрализации технологий. Если раньше доступ к нейросетям был привилегией тех, кто готов платить корпорациям и делиться своими данными, то теперь граница между «облачным» гигантом и персональным компьютером практически стерта.

Комментарии

Чтобы оставить комментарий, войдите в аккаунт.